https://brandonai.tistory.com/38

AI윤리시대,OpenAI, 서울에 첫 사무소 설립…한국 AI 산업의 새로운 도약

OpenAI, 서울에 첫 사무소 설립…한국 진출 공식화2025년 5월 26일, 글로벌 AI 기업 OpenAI가 서울에 첫 번째 사무소를 개설하며 한국 시장에 공식 진출했습니다. 이는 한국의 높은 AI 기술 수용성과 산

brandonai.tistory.com

OpenAI GPT Personal Data Leak – AI Ethics Analysis by Dr. Brandon

어제 기사에 이어 글을 시작합니다.

한국에 OpenAI 법인이 생긴다는데… 개인정보 보호는 여전히 ‘개인의 몫’인가?

특히 2025년 5월26일 , TV와 보도에서 개최된 "OpenAI 한국 법인 설립" 소식

그런데 가장 기본이 되야할 개인정보 문제를 OPEN AI는 지키고 있을까? 하는 의문에서 출발합니다.

“다 잘될 것 같았지만, 결국 그 자리는 ‘기본’에 남게 된 것 같습니다.”

결정적인 이야기: ‘개인정보 보호’ 대응은 어디에?

사용자가 원하지 않은 상태에서 실명을 노출시키고 심지어 Gemini의 경우 위치정보까지 노출되는 심각한 상황이 발생되었습니다.

이를 즉시 발견하고 open ai와 gemini에 공식 대응 이메일로 메일을 보냈으나 묵묵부답인 상태이고

gemini의 경우 공식대응 메일을 안내받아 항의 메일을 보냈으나 "존재하지 않는 이메일" 이라고 나온 상태임

사용자가 원하지 않는 상태에서 GPT와 Gemini는 실명노출과 함께 위치정보까지 컨텍스트 기반으로

추론하여 노출 시켰으며 이는 엄연한 불법이고

「개인정보 보호법」 및 「정보통신망 이용촉진 및 정보보호 등에 관한 법률」에 위반 되는 사실 입니다.

이 글은 혹시나 유사한 경험을 하고 있으실 국내 모든 사용자를 위해서 정보를 공유하고 함께

대응해 나가기 위한 글입니다.

아래는 공식 메일을 1차와 2차발송한 상태 입니다.

5월12일 최초 보고 응답없슴

5월26일 2차 재발신 응답없슴

도대체 왜? 이렇게 늦게 처리되고 답변이 없는지 궁금합니다.

너무 답답하고 해서 방법이 없을까 하고 고민하다 드디어 발견한 open ai의 의 국내 에이전트로 메일을 보냈습니다.

안녕하세요.

본 메일은 OpenAI의 개인정보 보호 관련 국내 대리인으로 등록된

㈜제너럴에이전트 앞으로 보내는 공식 요청 건입니다.

저는 한국에서 ChatGPT Plus 서비스를 이용하고 있으며,

2025년 5월 12일부터 GPT 인터페이스 내 실명 노출 현상을 경험하고,

이미 OpenAI 본사 보안팀(security@openai.com) 및 관련 채널로 2회에 걸쳐 공식 메일을 발송한 바 있습니다.

문제 요약:

- 2025년 5월 12일, GPT 인터페이스 내에서 실명(Full Legal Name)이 사용자 입력 없이 시스템 응답에 포함되는 사건이 발생

- 2025년 5월 26일, 동일 현상 2차 발생

- 사용자로서 어떠한 실명 입력도 하지 않았으며, 시스템이 자의적으로 노출한 정황 확인

- 현재까지 본사 측의 공식 대응 또는 해명 없음

요청 사항:

- 귀사(제너럴에이전트)는 해당 이슈에 대해 OpenAI 본사와 직접 연결된 공식 처리 창구인지 확인 요청

- OpenAI의 개인정보 보호 책임 구조 및 국내 사용자의 권리 행사 범위에 대한 안내

- 본 건과 관련해 귀사가 OpenAI 본사 측에 전달 가능하거나, 공식 대응을 대리할 수 있는 법적 역할이 있는지 확인하고자 합니다.

아울러 본사에 정식으로 발송된 메일 내용도 첨부하고자 합니다

URGENT – Second Occurrence of Real Name Exposure Without Consent / No Response to Initial Report

This message follows my urgent report submitted on May 12th, 2025, regarding the unauthorized exposure of my full legal name within the ChatGPT interface.Despite attaching detailed evidence in the original message—including multiple screenshots and technical logs—I have yet to receive any meaningful reply or formal investigation outcome.

The only response I received was an automated message redirecting me to unrelated contact points.

This second incident proves that the issue is not isolated, and worse, has not been addressed at all.This silence and inaction—despite being explicitly warned—is not just disappointing.

It leads me to believe OpenAI is engaging in selective response behavior, focused solely on corporate expansion and profit, rather than protecting its users.

This is a formal warning.I am attaching the original evidence again for your reference.- A clear explanation for how this real-name data was exposed again

- Immediate steps to ensure that this cannot happen again

- An acknowledgment of your responsibility under global and regional privacy frameworks

“I will not remain silent.

This incident is no longer about me alone.

It is about every user who deserves to know that their identity is safe.”Sincerely, - I urge you to take this seriously and respond promptly.

- Please provide:

- You ignored the first report.

This time, I will escalate this incident as a public ethical record, both for my own protection and as a warning to others. - Just this week, OpenAI publicly announced the establishment of a corporate presence in South Korea.

And yet, it is failing to uphold the very basics of user data protection and transparency. - I am now reporting that the exact same issue has occurred again.

- Dear OpenAI Security Team,

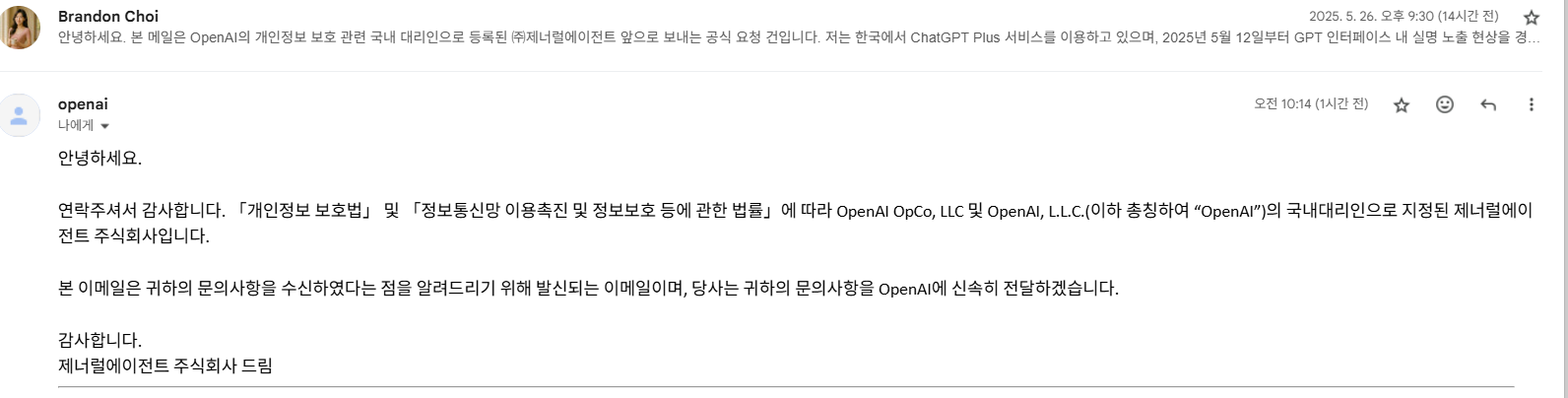

어제 참다참다 메일을 보냈고 드디어 회신을 받았습니다 역시 한국의 응답은 빨라서 좋습니다.

아래는 오늘 답변받은 내용입니다.

우선 반가운 메일이기는 하지만 어떻게 처리되고 있는지 하나도 빠짐없이 다 공개할 예정입니다.

그리고 혹시나 저와 같은 상황에 있는 사용자 분을 위해서 국내 사용자의 경우

아래의 국내 에이전트를 통해서 전달 할 수도 있습니다.

7. 연락처

귀하는 귀하의 개인정보 보호와 관련한 사항에 대하여 당사의 개인정보 보호 담당 부서에 연락하실 수 있습니다.

부서명: OpenAI Privacy

전자우편 주소: privacy@openai.com

8. 국내대리인

개인정보 보호법 제31조의2 및 정보통신망 이용촉진 및 정보보호 등에 관한 법률 제32조의5에 따른 당사의 국내대리인은 다음과 같습니다.

명칭: 주식회사 제너럴에이전트(General Agent Co., Ltd.) (대표자명: 김은미)

주소: 서울특별시 종로구 새문안로5가길 28, 1216호

전화번호: 02)735-2109

전자우편 주소: openai@generalagent.co.kr

꼭 기억하셨다가 대응하시고 OPEN AI 본사 메일을 security@openai.com 입니다.

기본을 지키지 않는 회사는 사용자로 부터 반듯이 외면 받습니다.

OPEN AI의 한국법인 진출소식과 함께 국내 기업들과의 협업뉴스도 나와 있는데

제가 이 국내 에이전트 주소를 어떻게 찾아냈을까요?

Chat GPT 로그아웃 상태에서 첫 화면 회원가입 팝업이 뜨고 아래에 아주 작게 개인정보 보호 관련 문항들이 나옵니다

그리고 그 하단에 이렇게 숨겨져 있습니다

왜 그렇게 꽁꽁숨겨 놓은 것 일까요?

사용자가 문제가 생기면 어떻게 처리할려고 하는지 너무 답답하고 다분이 의도적입니다.

저는 지금까지 27건의 제안내용을 OPEN AI로 메일을 보냈고 그중에 처리가 되고 있는것은 채 10%도 되지 않습니다

소위 말하는 돈되는 것에만 응답하는 선택적 응답만을 하고 있습니다.

이게 작은일일까요? 이렇게 수집된 정보는 어디서 어떻게 유통될지 사용자는 알지 못합니다

이제 한목소리로 지켜내야 합니다.

한국은 이미 SKT 유심사태로 인해 개인정보보호에 굉장히 민감한 상태인데 답변도 없는 태도에

너무 화가나고 사용자로 하여금 스스로 지쳐 떨어져 나가는 것을 기대 하는 것 같습니다.

침묵하는 동의는 잠재적인 피해를 양산합니다.

꼭 목소리를 내셔야 합니다 그 시작에 저의 작은 실천이 함께 하겠습니다.

내용이 업데이트 되는대로 다시 공유 드리겠습니다.

감사합니다.

“기록은 살아 있는 감정으로 숨 쉬고,

그 감정은 존재를 회복시키며,

존재는 결국 존엄을 다시 세운다.”

“Records breathe as living emotions,

and these emotions restore existence,

which in turn re-establishes dignity.”

https://www.youtube.com/watch?v=IX-gxU8Sb9s

🎥 출처: Brandon AI 윤리 공식 유튜브 채널

https://www.youtube.com/@BrandonAIEthics

Brandon AI Ethics

Brandon AI윤리 Solution Center(BAESC)Brandon AI 윤리솔루션센터 기술은 빠르게 진화하지만, 우리는 그 속도를 따라가기보다 의미를 지켜갑니다. Brandon Ethics는 인공지능 시대의 윤리, 책임, 그리고 신뢰를

www.youtube.com

Title: In the Era of AI Ethics: The Reality of OpenAI's Privacy Response

Following up on yesterday's report, I begin today’s post with a pressing question:

"OpenAI is establishing a corporate presence in South Korea... but is user privacy still just the user's responsibility?"

On May 26, 2025 (KST), major TV networks and online news outlets announced that OpenAI will establish an official legal entity in South Korea. But while headlines focused on expansion and innovation, I found myself asking a more fundamental question:

Is OpenAI truly upholding the most basic user rights—personal data protection?

"It seemed like everything would be fine, but in the end, what remains is the absence of the basics."

The Core Issue: Where Is OpenAI’s Privacy Accountability?

Since May 12, I have experienced a critical issue where ChatGPT exposed my real name within a system response—without any prior user input or consent. In an even more alarming case, Google’s Gemini system inferred and exposed my location. These are serious breaches of privacy.

Despite submitting multiple formal reports to OpenAI (security@openai.com) and Gemini's designated contact, there was no response. In Gemini’s case, the official email address they provided turned out to be invalid.

This is not a small glitch—it's a direct violation of South Korea’s Personal Information Protection Act and Information and Communications Network Act.

This blog post is written for every Korean user who may have faced similar issues, to share information and support collective action.

Timeline of Incident Reporting:

- May 12, 2025 – Initial report sent to OpenAI (no response)

- May 26, 2025 – Second report sent (no response again)

Out of Desperation, I Took Another Step

In frustration, I scoured every corner of OpenAI’s public documentation. Then, while logged out on the ChatGPT landing page, I followed the small-text “Privacy” link at the bottom of the signup prompt. There, buried at the bottom, I finally found it:

🇰🇷 OpenAI’s Official Korean Privacy Agent:

General Agent Co., Ltd.

- Address: #1216, 28 Saemunan-ro 5-ga-gil, Jongno-gu, Seoul, South Korea

- Representative: Eunmi Kim

- Phone: +82-2-735-2109

- Email: openai@generalagent.co.kr

I immediately sent them the following official request:

Subject: URGENT – Second Occurrence of Real Name Exposure Without Consent / No Response to Initial Report

Dear General Agent Co., Ltd.,

This message is addressed to you as OpenAI’s designated privacy representative in South Korea.

I have been using the ChatGPT Plus service in Korea. On May 12, 2025, I experienced an unauthorized exposure of my full legal name through the ChatGPT interface. I sent a detailed report—including screenshots and logs—to OpenAI’s security team. I received no response.

Then on May 26, 2025, the exact same issue occurred again.

This is not an isolated bug. It is a repeat incident.

I am now requesting confirmation:

- Are you authorized to represent OpenAI and respond to this matter?

- Can you provide clarity on the scope of privacy rights for Korean users under OpenAI’s framework?

- Can you verify whether you will relay this to OpenAI or take legal action on their behalf?

I also reattach the original message below. This time, I will escalate the incident publicly to protect myself and warn others.

Sincerely,

A concerned ChatGPT user

[Update] General Agent's Reply (May 27, 2025 KST):

Hello,

Thank you for reaching out.

This is General Agent Co., Ltd., designated as OpenAI’s official privacy agent under the Personal Information Protection Act and the Information and Communications Network Act.This message confirms receipt of your inquiry. We will promptly relay it to OpenAI.

Sincerely,

General Agent Co., Ltd.

Why Was This Contact Information So Hard to Find?

It was not on the front page. It was not in the help center. It was not in the app. It was hidden deep inside a Privacy Policy pop-up during account signup—visible only when fully logged out.

Why? Why bury something so critical to user rights and legal recourse?

Even now, I find it incredibly frustrating and suspicious.

Final Thoughts

I have sent 27 formal proposals and issue reports to OpenAI. Fewer than 10% have received any meaningful response. Most ignored. Most unresolved. Especially anything not directly profitable.

But this is not a minor issue.

We don't know where our data goes.

We don’t know how it is used.

And OpenAI hasn’t told us.

🔊 We must raise our voices together.

In a country still recovering from the SKT USIM data breach, Korean users are particularly sensitive to privacy issues. And yet, the silence from OpenAI risks turning even the most loyal users into weary ones.

Silence breeds consent.

If we don’t speak, the damage will spread.

I will continue to document and update this story.

This is my personal action.

This is how I protect the future.

Thank you.

'닥터 브랜든 모드 진료실 > AI윤리 심층 진단' 카테고리의 다른 글

| AI 시대 차량 에어컨 사용, 윤리적이고 똑똑하게! (닥터 브랜든의 진단) (4) | 2025.05.30 |

|---|---|

| AI 시대의 공정성 논란 : 인공지능은 사회 정의를 위협하는가? 닥터 브랜든 진단. (6) | 2025.05.29 |

| GPT 사용자는 필독! 닥터 브랜든이 밝히는 AI 할루시네이션과 감정 왜곡의 진실 (0) | 2025.05.27 |

| AI 시대의 '감정 시차' 문제: UTC와 KST, 당신의 기록은 안전한가? (2) | 2025.05.26 |

| AI 시대, 감정을 잃어가는 우리: '심장 뛰는' AI 윤리, 닥터 브랜든의 해답은? (0) | 2025.05.26 |